Significado de matriz Definición, operaciones, rango e inversa

Doctor en Ingeniería

Definición formal

La matriz comprende un arreglo de números cuya configuración está dada por filas y columnas, y funciona como la representación compacta de un sistema lineal.

Consideremos el sistema lineal de dos ecuaciones y dos incógnitas

\(a_{1,1}x_1 + a_{1,2}x_2 &= b_1\) ,

\(a_{2,1}x_1 + a_{2,2}x_2 &= b_2\) ,

donde todos los elementos son números reales. Este sistema puede expresarse mediante una notación matriz-vector, definiendo

\(

A \doteq

\begin{bmatrix}

a_{1,1} & a_{1,2}\\

a_{2,1} & a_{2,2}

\end{bmatrix}, \quad

x \doteq

\begin{bmatrix}

x_1\\

x_2

\end{bmatrix}, \quad

b \doteq

\begin{bmatrix}

b_1\\

b_2

\end{bmatrix},

\)

donde A es una matriz, y x y b se llaman vectores, y no son otra cosa que matrices con una sola columna (o fila).

Con estas definiciones, el sistema puede reescribirse como

\(Ax = b\) ,

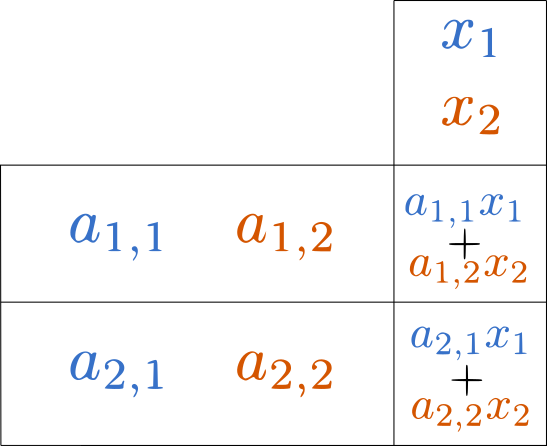

donde el significado es el mismo que en el sistema lineal. Esta notación resulta sumamente útil cuando se trabaja con matrices más grandes, muy comunes en muchas aplicaciones prácticas. Una ayuda visual para recordar cómo se realiza este producto es poner los elementos dentro de una tabla, como en la Figura 1.

Operaciones: transposición, suma, y producto

Consideremos la matriz \(A \in \mathbb{R}^{N\times M}\), que quiere decir que A tiene N filas y M columnas, y que sus entradas o elementos son números reales. Podemos definir inmediatamente tres propiedades:

– Transposición: La matriz transpuesta \(B=A^T\in \mathbb{R}^{M\times N}\) se define como aquella cuyos elementos se definen como \(b_{n,m} = a_{m,n}\). Por ejemplo, si

\(

A =

\begin{bmatrix}

1 & 3\\

5 & 7 \\

9 & 2

\end{bmatrix}, \quad

A^T =

\begin{bmatrix}

1 & 5 & 9\\

3 & 7 & 2

\end{bmatrix}.

\)

– Suma: C = A + B si sus elementos \(c_{n,m} = a_{n,m}+b_{n,m}\). Ejemplo:

\(

A =

\begin{bmatrix}

1 & 2\\

3 & 3 \\

4 & 1

\end{bmatrix}, \quad

A =

\begin{bmatrix}

1 & 2\\

1 & 2 \\

2 & 1

\end{bmatrix},\quad

C =

\begin{bmatrix}

2 & 4\\

4 & 5 \\

6 & 2

\end{bmatrix}

\)

Notemos que para que esta operación esté definida, A y B deben ser necesariamente del mismo tamaño.

– Producto: El producto de matrices es análogo a la multiplicación matriz x vector, si consideramos a la matriz de la derecha como un conjunto de vectores columna puestos uno al lado del otro. Es decir, si \(B\in \mathbb{M\times K}\), entonces C = AB si sus elementos \(c_{n,k} = \sum_{m=1}^M a_{n,m}b_{m,k}\). Por ejemplo,

\(

A =

\begin{bmatrix}

1 & 2\\

1 & 2 \\

2 & 1

\end{bmatrix},\quad

B =

\begin{bmatrix}

2 & 1\\

1 & 1

\end{bmatrix},\quad

C =

\begin{bmatrix}

4 & 3 \\

4 & 3 \\

5 & 3

\end{bmatrix}.

\)

Notemos que para que esta operación pueda realizarse, debe coincidir la cantidad de columnas de A con la cantidad de filas de B.

Rango de una matriz

Cuando resolvemos un sistema lineal, sabemos que el sistema puede tener una, ninguna o infinitas soluciones, dependiendo de los factores que multipliquen a las incógnitas. Intuitivamente, dos ecuaciones muy parecidas en un mismo sistema pueden estar «pidiéndole lo mismo» a las variables. Es decir, ser redundantes. Esto es más fácil aún de ver en las matrices mediante el cálculo de su Rango.

El Rango de una matriz se define como el número de vectores fila que la conforman que son linealmente independientes. Es decir, que no pueden escribirse como combinación lineal de otros vectores de la matriz. El caso más trivial se da cuando una matriz tiene dos filas iguales, y si pensamos en su sistema de ecuaciones asociado, esto significa que la misma ecuación aparece dos veces.

Hay varias formas de calcular el rango de una matriz, siendo el método de Gauss uno de los más intuitivos. Sin entrar en detalles de este procedimiento, una vez calculado el rango R de una matriz \(A \in \mathbb{R}^{N\times M}\), podemos hacer deducciones sobre el sistema de ecuaciones asociado. Para ello, llamemos \(C=[A|b]\) a la matriz A con el agregado del vector b como una columna adicional. Entonces

– Si R(A) = R(C), el sistema asociado es compatible (tiene al menos una solución).

– Si R(A) = R(C) = M, el sistema asociado es compatible determinado (tiene solución única).

Inversa de una matriz

Además de aportar información sobre el sistema asociado, el Rango de una matriz nos permite conocer su invertibilidad. Así como en la suma de matrices tenemos un elemento neutro obvio: la matriz nula, y es claro que A – A = 0 para toda matriz A, el producto también admite un elemento neutro llamado identidad que no es otra cosa que una matriz con unos en la diagonal y todos sus otros elementos nulos. Es decir,

\(

I =

\begin{bmatrix}

1 & 0 & 0 \\

0 & 1 & 0\\

0 & 0 & 1

\end{bmatrix}.

\)

Así como para la suma existe el elemento opuesto -A, para el producto de matrices cuadradas existe un elemento opuesto \(A^{-1}\), tal que \(AA^{-1} = A^{-1}A = I\). Esta matriz, llamada inversa, existe si y sólo si \(A\in \mathbb{R}^{N\times N}\) y \(R(A)=N\). Es decir, si A es cuadrada y de rango completo.

Como nota de color, si bien toda matriz cuadrada de rango completo es invertible, cuando en la práctica trabajamos con matrices muy grandes (por ejemplo de 10.000 x 10.000), puede ocurrir que la inversión no sea posible debido a mal condicionamiento, y en estos casos existen alternativas como Métodos de Regularización.

Trabajo publicado en: Feb., 2021.